Die kreative Kraft der Maschinen entfesseln: Generative KI, Large Language Models und die Zukunft der Contenterstellung

Geschrieben von Viktoria Koleva | 7. Juni 2023

Inhaltsverzeichnis

Lesen ist nichts für dich? Schaue dir unser Video an!

Seit Anbeginn der Zeit nutzen wir die Kraft der Natur, um Werkzeuge zu schaffen, die unser Leben einfacher und produktiver machen – Innovationen zu schaffen. Inspiriert von den Wundern der Natur haben wir Kunst, Literatur und Architektur kreiert, die uns auf eine Reise zu einem besseren Selbstverständnis führen. Jetzt geben wir dieses Wissen weiter und befähigen andere, nach Mustern, Abläufen und Bedeutung zu suchen – Maschinen. Und all das in unserem ewigen Streben nach Innovation.

Die Grenzen zwischen menschlicher Kreativität und maschineller Innovation sind längst fließend. Wo der menschliche Verstand vor einer Herausforderung steht, bietet die Maschine einen Ausweg. Wo die Maschine an ihre Grenzen stößt und in eine Sackgasse gerät, findet der Mensch einen neuen Weg. Ein Beispiel dafür ist die generative KI, eine Form der künstlichen Intelligenz, die neue und originelle Inhalte wie Texte, Bilder, Audio, Videos und synthetische Daten auf der Grundlage der Eingaben, auf die sie trainiert wurde, erzeugen kann. An der Spitze dieser Innovation steht GPT (Generative pre-trained transformer), ein fortschrittliches Sprachmodell, das die KI-gestützte Contenterstellung ermöglicht.

In diesem Blog diskutieren wir wie sich menschlicher Erfindergeist und künstliche Intelligenz überschneiden und die nächste technologische Revolution vorantreiben. Wie verändert sich unser Denken? Wie erstellen und erleben wir Content zukünftig? All das wirst du im Folgenden erfahren.

Die Grenzen zwischen menschlicher Kreativität und maschineller Innovation sind längst fließend. Wo der menschliche Verstand vor einer Herausforderung steht, bietet die Maschine einen Ausweg. Wo die Maschine an ihre Grenzen stößt und in eine Sackgasse gerät, findet der Mensch einen neuen Weg. Ein Beispiel dafür ist die generative KI, eine Form der künstlichen Intelligenz, die neue und originelle Inhalte wie Texte, Bilder, Audio, Videos und synthetische Daten auf der Grundlage der Eingaben, auf die sie trainiert wurde, erzeugen kann. An der Spitze dieser Innovation steht GPT (Generative pre-trained transformer), ein fortschrittliches Sprachmodell, das die KI-gestützte Contenterstellung ermöglicht.

In diesem Blog diskutieren wir wie sich menschlicher Erfindergeist und künstliche Intelligenz überschneiden und die nächste technologische Revolution vorantreiben. Wie verändert sich unser Denken? Wie erstellen und erleben wir Content zukünftig? All das wirst du im Folgenden erfahren.

1. Generative KI erklärt

Mittlerweile hat fast jeder schon mal etwas über generative KI, OpenAI und ChatGPT gehört, gelesen oder gesehen. Warst du auch schon mal etwas überwältigt von den zahlreichen Blogartikeln und Videos darüber, was genau generative KI ist? Das liegt daran, dass du deine KI-Reise zu einem späteren Zeitpunkt begonnen hast und einige wichtige Meilensteine verpasst hast, die den Kontext deiner gesamten Reise bestimmen werden. Gehen wir also einen Schritt zurück und tauchen wir zuerst in die Welt der künstlichen Intelligenz und des maschinellen Lernens ein.

1.1 Künstliche Intelligenz vs. Machine Learning

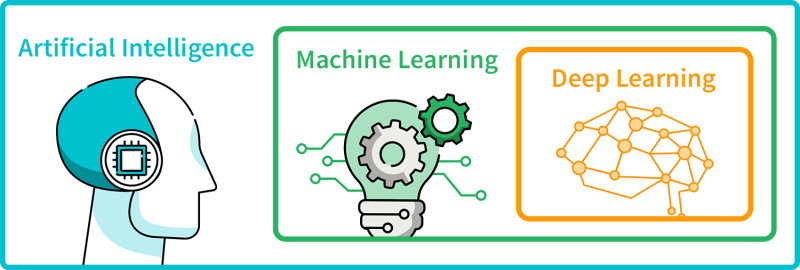

Künstliche Intelligenz (KI) ist eine Disziplin der Informatik, die sich mit der Entwicklung intelligenter Agenten beschäftigt – Systeme, die in der Lage sind, selbstständig zu denken, zu lernen und zu handeln. Im Wesentlichen, geht es darum, Computersysteme zu entwickeln, die wie Menschen denken und handeln. Machine Learning (ML) hingegen ist ein Teilbereich der künstlichen Intelligenz, der sich mit der Entwicklung und dem Einsatz von selbstlernenden Algorithmen beschäftigt. Diese Algorithmen leiten Wissen aus Daten ab, um mögliche Ergebnisse vorherzusagen. ML-Algorithmen ermöglichen es Computern, automatisch aus Daten ohne explizite Anweisungen zu lernen und sich zu verbessern. Stattdessen können sie Muster erkennen und auf der Grundlage der empfangenen Daten Rückschlüsse ziehen.

Zwei der gebräuchlichsten Kategorien von ML-Lernmodellen sind überwachte (supervised learning) und unüberwachte (unsupervised) ML-Modelle. Beim überwachten Lernen werden gekennzeichnete Datensätze verwendet, um Algorithmen für die Klassifizierung und Vorhersage von Daten zu trainieren. Beschriftete Daten werden mit einem Tag wie einem Namen, einem Typ oder einer Zahl versehen. Beim überwachten Lernen nutzt der Algorithmus Beispiele aus der Vergangenheit, um zukünftige Werte vorherzusagen. Auf der Grundlage der Eingabedaten erstellt das Modell eine Prognose und vergleicht sie mit den Trainingsdaten, die für das Modell verwendet wurden (erwartete Werte). Wenn die erwarteten Datenwerte und die Trainingsdaten weit voneinander entfernt sind, entsteht ein Fehler. Das Modell versucht dann, den Fehler zu verringern, bis das prognostizierte und das erwartete (tatsächliche vs. gewünschte) Ergebnis übereinstimmen.

Beim unüberwachten Lernen werden, wie der Name schon sagt, unbeschriftete Datensätze verwendet. Es geht darum, mit Rohdaten zu arbeiten und herauszufinden, ob sie auf natürliche Weise in Gruppen mit gemeinsamen Merkmalen fallen. Ein dritter Typ von ML-Lernmodellen ist das verstärkende maschinelle Lernen. Das verstärkende maschinelle Lernen ähnelt dem überwachten Lernen, aber der Algorithmus wird nicht mit Beispieldaten trainiert. Stattdessen lernt dieses Modell durch Versuch und Fehler. Das bedeutet, dass eine Rückmeldung ( Fehlerauftritt) nicht nach jedem Vergleich (“prognostiziert” vs. “erwartet”) erfolgt, sondern nur dann, wenn der Zielzustand erreicht ist.

Zwei der gebräuchlichsten Kategorien von ML-Lernmodellen sind überwachte (supervised learning) und unüberwachte (unsupervised) ML-Modelle. Beim überwachten Lernen werden gekennzeichnete Datensätze verwendet, um Algorithmen für die Klassifizierung und Vorhersage von Daten zu trainieren. Beschriftete Daten werden mit einem Tag wie einem Namen, einem Typ oder einer Zahl versehen. Beim überwachten Lernen nutzt der Algorithmus Beispiele aus der Vergangenheit, um zukünftige Werte vorherzusagen. Auf der Grundlage der Eingabedaten erstellt das Modell eine Prognose und vergleicht sie mit den Trainingsdaten, die für das Modell verwendet wurden (erwartete Werte). Wenn die erwarteten Datenwerte und die Trainingsdaten weit voneinander entfernt sind, entsteht ein Fehler. Das Modell versucht dann, den Fehler zu verringern, bis das prognostizierte und das erwartete (tatsächliche vs. gewünschte) Ergebnis übereinstimmen.

Beim unüberwachten Lernen werden, wie der Name schon sagt, unbeschriftete Datensätze verwendet. Es geht darum, mit Rohdaten zu arbeiten und herauszufinden, ob sie auf natürliche Weise in Gruppen mit gemeinsamen Merkmalen fallen. Ein dritter Typ von ML-Lernmodellen ist das verstärkende maschinelle Lernen. Das verstärkende maschinelle Lernen ähnelt dem überwachten Lernen, aber der Algorithmus wird nicht mit Beispieldaten trainiert. Stattdessen lernt dieses Modell durch Versuch und Fehler. Das bedeutet, dass eine Rückmeldung ( Fehlerauftritt) nicht nach jedem Vergleich (“prognostiziert” vs. “erwartet”) erfolgt, sondern nur dann, wenn der Zielzustand erreicht ist.

1.2 Wo kommt Deep Learning ins Spiel?

Nachdem wir nun künstliche Intelligenz und maschinelles Lernen definiert haben, kommen wir zu Deep Learning und seinen Anwendungen für generative KI. Deep Learning ist ein Teilbereich des maschinellen Lernens, der künstliche neuronale Netze verwendet, die komplexere Muster verarbeiten können, als maschinelles Lernen. Neuronale Netze sind dem menschlichen Gehirn nachempfunden und versuchen, dessen Verhalten zu simulieren. Sie bestehen aus zahlreichen miteinander verbundenen Knoten oder Neuronen, die lernen, Aufgaben zu erfüllen, indem sie Daten verarbeiten und Prognosen machen. Also, wie unterscheidet sich Deep Learning von Machine Learning? Durch die Art der Daten und das Lernverhalten. Während Machine-Learning-Algorithmen strukturierte, gekennzeichnete Daten verwenden, die von Menschen analysiert und vorverarbeitet werden müssen, können Deep-Learning-Algorithmen auch unstrukturierte Daten verarbeiten. Sie automatisieren den Prozess der Merkmalsdefinition und heben somit die Abhängigkeit vom menschlichen Input teilweise auf. Das bedeutet, dass neuronale Netze sowohl beschriftete als auch unbeschriftete Daten verwenden können. Dieses Lernmodell wird teilüberwachtes Lernen (semi-supervised learning) genannt. Beim teilüberwachten Lernen werden neuronale Netze mit einer kleinen Menge an gekennzeichneten Daten und einer großen Menge an nicht gekennzeichneten Daten trainiert. Durch die Analyse der beschrifteten Daten lernt das neuronale Netz die Grundlagen der Aufgabe. Die unbeschrifteten Daten hingegen helfen dem neuronalen Netz, auf neue Beispiele zu generalisieren.

1.3 So verbindet sich alles – Generative KI definiert

Generative KI ist ein Teilbereich des Deep Learning, bei dem künstliche neuronale Netze sowohl beschriftete als auch unbeschriftete Daten verarbeiten und dabei überwachte, unüberwachte und teilüberwachte Lernmethoden verwenden. Kurz gesagt ist die generative KI eine Gruppe von Algorithmen, die neue Inhalte (statistisch wahrscheinliche Ausgaben) auf der Grundlage der Rohdaten erzeugen, auf denen sie trainiert wurden.

Generative KI hat sich in den letzten Jahren rasant entwickelt. Es gibt drei grundlegende Algorithmen, die diese Weiterentwicklung ermöglicht haben.

Generative KI hat sich in den letzten Jahren rasant entwickelt. Es gibt drei grundlegende Algorithmen, die diese Weiterentwicklung ermöglicht haben.

a) Generative Adversarial Networks (GANs) sind eine Art von generativen Modellen, die neue Datensätze erzeugen können, die den Trainingsdaten ähneln. GANs haben zwei Komponenten– der Generator und der Diskriminator. Der Generator erzeugt neue Datenmuster, die als Negativbeispiel für den Diskriminator dienen. Der Diskriminator lernt, die erzeugten falschen Daten von den echten Daten zu unterscheiden, wobei er den Generator bestraft, wenn er zweifelhafte Ergebnisse liefert. So kann das Modell lernen.

b) Variations-Auto-Encoder (VAE) sind eine Art von generativen Modellen, die eine komprimierte Darstellung von Eingabedaten erlernen können. VAEs bestehen aus zwei Komponenten – dem Encoder und dem Decoder. Der Encoder bezeichnet den Prozess, der aus der alten Datendarstellung eine neue Datendarstellung erzeugt. Der Decoder bezeichnet den umgekehrten Prozess. Ein weiterer wichtiger Begriff ist die Dimensionalitätsreduktion. Unter Dimensionalitätsreduktion verstehen man die Komprimierung von Daten. Dabei werden Daten komprimiert (vom Ausgangsraum zum verschlüsselten Raum, auch latenter Raum genannt), während der Decoder sie dekomprimiert. Abhängig von der ursprünglichen Verteilung der Daten, der Definition des Kodierers und des latenten Raums können einige Informationen verloren gehen und ihre Wiederherstellung kann unmöglich sein. Einmal trainiert, können VAEs neue Datenproben generieren, indem sie zufällig Punkte aus der erlernten Verteilung des latenten Raums auswählen und sie mit dem Decoder-Netzwerk dekodieren. Diese Eigenschaft macht VAEs nützlich für Aufgaben wie Datensynthese, Erkennung von Anomalien und Dimensionalitätsreduktion.

c)Transformer-Netzwerke sind eine Art neuronaler Netze, die mit aufeinanderfolgenden Daten arbeiten können, z.B. mit natürlicher Sprache. Ihre wichtigste innovative Eigenschaft ist ihr Selbstbeobachtungsmechanismus. Während klassische neuronale Netze die Eingabedaten sequentiell verarbeiten, können Transformatoren Daten parallel verarbeiten. Der Selbstbeobachtungsmechanismus ermöglicht es dem Modell, die Wichtigkeit verschiedener Eingabeelemente (Wörter oder Tokens) bei der Erstellung von Prognosen zu bestimmen und dabei ihre Beziehung im Kontext zu berücksichtigen.

b) Variations-Auto-Encoder (VAE) sind eine Art von generativen Modellen, die eine komprimierte Darstellung von Eingabedaten erlernen können. VAEs bestehen aus zwei Komponenten – dem Encoder und dem Decoder. Der Encoder bezeichnet den Prozess, der aus der alten Datendarstellung eine neue Datendarstellung erzeugt. Der Decoder bezeichnet den umgekehrten Prozess. Ein weiterer wichtiger Begriff ist die Dimensionalitätsreduktion. Unter Dimensionalitätsreduktion verstehen man die Komprimierung von Daten. Dabei werden Daten komprimiert (vom Ausgangsraum zum verschlüsselten Raum, auch latenter Raum genannt), während der Decoder sie dekomprimiert. Abhängig von der ursprünglichen Verteilung der Daten, der Definition des Kodierers und des latenten Raums können einige Informationen verloren gehen und ihre Wiederherstellung kann unmöglich sein. Einmal trainiert, können VAEs neue Datenproben generieren, indem sie zufällig Punkte aus der erlernten Verteilung des latenten Raums auswählen und sie mit dem Decoder-Netzwerk dekodieren. Diese Eigenschaft macht VAEs nützlich für Aufgaben wie Datensynthese, Erkennung von Anomalien und Dimensionalitätsreduktion.

c)Transformer-Netzwerke sind eine Art neuronaler Netze, die mit aufeinanderfolgenden Daten arbeiten können, z.B. mit natürlicher Sprache. Ihre wichtigste innovative Eigenschaft ist ihr Selbstbeobachtungsmechanismus. Während klassische neuronale Netze die Eingabedaten sequentiell verarbeiten, können Transformatoren Daten parallel verarbeiten. Der Selbstbeobachtungsmechanismus ermöglicht es dem Modell, die Wichtigkeit verschiedener Eingabeelemente (Wörter oder Tokens) bei der Erstellung von Prognosen zu bestimmen und dabei ihre Beziehung im Kontext zu berücksichtigen.

Generative KI-Modelle werden mit einer Vielzahl von Modellen und Frameworks wie Deep Learning Frameworks, Markov Chain Monte Carlo (MCMC), Reinforcement Learning und Large Language Models erstellt (mehr dazu im nächsten Abschnitt).

Zusammenfassend lässt sich sagen, dass die generative KI ein Teilbereich des Deep Learning ist, der sich mit der Erstellung neuer Inhalte wie Text, Bilder, Audio und Video mithilfe verschiedener Algorithmen befasst, die auf einem bestimmten Datensatz trainiert wurden. Die Algorithmen nutzen dieses Wissen, um neue, zuvor nicht gesehene Muster zu erzeugen, die nicht mit den Eingabedaten identisch sind, aber dieselben Eigenschaften aufweisen.

Zusammenfassend lässt sich sagen, dass die generative KI ein Teilbereich des Deep Learning ist, der sich mit der Erstellung neuer Inhalte wie Text, Bilder, Audio und Video mithilfe verschiedener Algorithmen befasst, die auf einem bestimmten Datensatz trainiert wurden. Die Algorithmen nutzen dieses Wissen, um neue, zuvor nicht gesehene Muster zu erzeugen, die nicht mit den Eingabedaten identisch sind, aber dieselben Eigenschaften aufweisen.

2. Large Language Models (LLMs)

Large Language Models sind eine Unterkategorie von Deep Learning LLMs sind große, universell einsetzbare Sprachmodelle. Sie vearbeiten große Mengen von Textdaten und lernen aus den Mustern und Beziehungen zwischen Wörtern, Phrasen und Sätzen in natürlicher Sprache unter Verwendung fortschrittlicher neuronaler Netzwerkarchitekturen.Große Sprachmodelle werden für generelle Zwecke trainiert, um alltägliche Sprachprobleme zu lösen, z. B. Textklassifizierung, Beantwortung von Fragen, Dokumentenzusammenfassung und Texterstellung. Die Modelle können dann zur Lösung spezifischer Probleme in verschiedenen Bereichen anhand kleiner Datensätze verfeinert werden.

Hier sind einige der wichtigsten Merkmale, die große Sprachmodelle auszeichnen:

a) Größe und Umfang: Große Sprachmodelle werden mit einer riesigen Textmengentrainiert, die Milliarden von Wörtern umfassen.

b) Kontextabhängiges Verständnis: LLMs nutzen Mechanismen der Selbstbeobachtung und Transformatoren, um Verbindungen zwischen Wörtern und Sätzen zu erkennen und kontextbezogene Antworten zu geben.

c) Universalität: LLMs können alltägliche Sprachprobleme lösen, indem sie auf Gemeinsamkeiten in der menschlichen Sprache zurückgreifen.

d) Pre-Training and Anpassen: Nach dem Pre-Training auf einem großen Datensatz können LLMs mit Hilfe eines kleineren Datensatzes auf spezifische Aufgaben oder Bereiche abgestimmt werden. Das Anpassen trägt dazu bei, die Leistung des Modells für bestimmte Anwendungen zu optimieren, so dass es genauere und kontextbezogene Antworten geben kann.

a) Größe und Umfang: Große Sprachmodelle werden mit einer riesigen Textmengentrainiert, die Milliarden von Wörtern umfassen.

b) Kontextabhängiges Verständnis: LLMs nutzen Mechanismen der Selbstbeobachtung und Transformatoren, um Verbindungen zwischen Wörtern und Sätzen zu erkennen und kontextbezogene Antworten zu geben.

c) Universalität: LLMs können alltägliche Sprachprobleme lösen, indem sie auf Gemeinsamkeiten in der menschlichen Sprache zurückgreifen.

d) Pre-Training and Anpassen: Nach dem Pre-Training auf einem großen Datensatz können LLMs mit Hilfe eines kleineren Datensatzes auf spezifische Aufgaben oder Bereiche abgestimmt werden. Das Anpassen trägt dazu bei, die Leistung des Modells für bestimmte Anwendungen zu optimieren, so dass es genauere und kontextbezogene Antworten geben kann.

Sprachmodelle werden mit Daten aus verschiedenen Quellen wie Wikipedia, Webseiten und Communities wie Reddit trainiert. Aber auch menschliche Fähigkeiten werden genutzt, um die Daten zu verfeinern. Der Trainingsprozess ähnelt dem, den wir beim Erlernen neuer Sprachen durchlaufen – wir müssen sowohl von Lehrern angeleitet werden als auch in einer Umgebung sein, in der wir Muttersprachler hören und beobachten können.

Wofür werden also große Sprachmodelle verwendet? Zu den Anwendungsfällen gehören Übersetzungen, die Erstellung von Inhalten (Blogartikel, Produktbeschreibungen usw.), Chatbots, Zusammenfassungen großer Textmengen und vieles mehr.

Wofür werden also große Sprachmodelle verwendet? Zu den Anwendungsfällen gehören Übersetzungen, die Erstellung von Inhalten (Blogartikel, Produktbeschreibungen usw.), Chatbots, Zusammenfassungen großer Textmengen und vieles mehr.

3. GPT, ChatGPT und mehr

Nachdem wir nun verstanden haben, was Generative KI und LLMs sind, schauen wir uns die verschiedenen Sprachmodelle an, die es gibt. Im Laufe der letzten Monate hat fast jeder von uns etwas über ChatGPT gehört oder gelesen. Was bedeutet GPT also genau, was ist ChatGPT und was hat das mit OpenAI zu tun?

GPT steht für Generative Pre-trained Transformer – eine Familie von neuronalen Netzwerkmodellen, die die Transformer-Architektur nutzen. GPTs befähigen verschiedene Anwendungen, Text und Inhalte zu generieren, die menschlichen Werken sehr ähnlich sind (Bilder, Audio, Video usw.). Darüber hinaus können diese Anwendungen Konversationen führen und Fragen beantworten, die von Benutzern gestellt werden. Zu den Einsatzgebieten von GPT gehören:

GPT steht für Generative Pre-trained Transformer – eine Familie von neuronalen Netzwerkmodellen, die die Transformer-Architektur nutzen. GPTs befähigen verschiedene Anwendungen, Text und Inhalte zu generieren, die menschlichen Werken sehr ähnlich sind (Bilder, Audio, Video usw.). Darüber hinaus können diese Anwendungen Konversationen führen und Fragen beantworten, die von Benutzern gestellt werden. Zu den Einsatzgebieten von GPT gehören:

– Erstellen von Marketinginhalten wie Social Media Posts, Blogartikel, E-Books, Leitfäden, Pitch Decks, E-Mail-Marketingkampagnen

– Neuformulierung von Sätzen, Änderung der Tonalität und des Stils von Texten

– Schreiben und Erlernen von Code

– Analysieren, Strukturieren und Präsentieren von Daten

– Interaktive Sprachassistenten entwickeln

– Bilder, Audio- und Videoinhalte erstellen

– Neuformulierung von Sätzen, Änderung der Tonalität und des Stils von Texten

– Schreiben und Erlernen von Code

– Analysieren, Strukturieren und Präsentieren von Daten

– Interaktive Sprachassistenten entwickeln

– Bilder, Audio- und Videoinhalte erstellen

3.1 Was genau ist ChatGPT?

ChatGPT ist ein interaktives KI-Modell, das von OpenAI, einem 2015 gegründeten Labor für künstliche Intelligenz in San Francisco, entwickelt wurde. Es basiert auf der GPT-Architektur und ist darauf ausgelegt, textbasierte Konversationen mit Nutzern zu führen.

hatGPT wird mit einer großen Menge an Daten aus dem Internet trainiert und kann so menschenähnliche Äußerungen verstehen und generieren. Es ist in der Lage, schlüssige und kontextrelevante Antworten auf Fragen zu geben, einen Dialog zu führen und sogar einen gewissen Gesprächsfluss zu erzeugen.

Ähnlich wie GPT kann ChatGPT in einer Vielzahl von Bereichen und für unterschiedliche Zwecke eingesetzt werden. Einige davon sind:

Ähnlich wie GPT kann ChatGPT in einer Vielzahl von Bereichen und für unterschiedliche Zwecke eingesetzt werden. Einige davon sind:

– Kundensupport/virtuelle Assistenten: ChatGPT kann als virtueller Assistent eingesetzt werden, der sofortige Antworten auf Benutzeranfragen gibt und sie durch einen Prozess oder eine Fehlerbehebung führt

– Erstellung von Inhalten: Marketingfachleute und Content-Entwickler können ChatGPT nutzen, um Brainstorming zu betreiben oder Blog-Artikel, Pitch Decks, Strategien usw. zu erstellen.

– Pädagogische Unterstützung: ChatGPT kann Studierenden helfen, Fragen zu beantworten, Konzepte zu erklären und zusätzliche Lernressourcen bereitzustellen. Es kann als Lernbegleiter fungieren, indem es interaktive Quizfragen anbietet oder bei der Recherche hilft.

– Informationstechnologie und Produktentwicklung: Teams können die generative KI nutzen, um das Schreiben von Code und Dokumentation zu erleichtern und Prototypen für Produktdesigns zu erstellen.

– Erstellung von Inhalten: Marketingfachleute und Content-Entwickler können ChatGPT nutzen, um Brainstorming zu betreiben oder Blog-Artikel, Pitch Decks, Strategien usw. zu erstellen.

– Pädagogische Unterstützung: ChatGPT kann Studierenden helfen, Fragen zu beantworten, Konzepte zu erklären und zusätzliche Lernressourcen bereitzustellen. Es kann als Lernbegleiter fungieren, indem es interaktive Quizfragen anbietet oder bei der Recherche hilft.

– Informationstechnologie und Produktentwicklung: Teams können die generative KI nutzen, um das Schreiben von Code und Dokumentation zu erleichtern und Prototypen für Produktdesigns zu erstellen.

ChatGPT beeindruckt Benutzer auf der ganzen Welt mit seinen Fähigkeiten und seiner Interaktivität. Dennoch, sollten wir uns alle darüber im Klaren sein, dass es manchmal Antworten produzieren kann, die zwar plausibel klingen, aber nicht immer genau oder sachlich richtig sind. Wir sollten daher bei der Verwendung des Programms vorsichtig sein und die von ihm gelieferten Daten stets überprüfen.

3.2 Welche anderen Sprachmodelle gibt es?

Während GPT in den letzten Monaten sicherlich viel Aufmerksamkeit erregt hat, gibt es noch andere Sprachmodelle, die durchaus einen Blick wert sind. Im Folgenden finden Sie einen Überblick über die gängigsten Modelle mit ihren Vor- und Nachteilen sowie ihren Funktionen:

GPT-3

Vorteile

Nachteile

Funktionen

Vorteile

Riesige Menge an Pretraining-Daten (45 Terabyte), Funktionen zur Generierung von Inhalten, Unterstützung verschiedener Aufgaben durch Prompt Engineering.

Nachteile

Erfordert beträchtliche Rechenressourcen, nur begrenzte Kontrolle über die generierte Ausgabe, Potenzial für verzerrte oder falsche Antworten.

Funktionen

Vervollständigen von Texten, Sprachübersetzung, Beantworten von Fragen, Chatbots, kreatives Schreiben.

BERT

Vorteile

Nachteile

Funktionen

Vorteile

Starkes kontextbezogenes Verständnis, effektiv für das Verständnis natürlicher Sprache, unterstützt die Feinjustierung für bestimmte Bereiche.

Nachteile

Rechenintensiv, nicht so gut für Textgenerierungsaufgaben geeignet, kein Verständnis für komplexe Zusammenhänge.

Funktionen

Erkennung benannter Entitäten, Stimmungsanalyse, Textklassifizierung, Beantwortung von Fragen.

Transformer-XL

Vorteile

Nachteile

Funktionen

Vorteile

Kann gut mit komplexen Zusammenhängen umgehen, versteht den Kontext über lange Texte hinweg, bessere Speicherkapazität.

Nachteile

Höhere Trainingszeit und Rechneranforderungen, langsamere Inferenzgeschwindigkeit im Vergleich zu anderen Modellen.

Funktionen

Sprachmodellierung, Texterstellung, Zusammenfassungen, Dokumentenklassifizierung.

GPT-2

Vorteile

Nachteile

Funktionen

Vorteile

Erzeugung qualitativ hochwertiger Texte, bessere Kontrolle über die erzeugte Ausgabe im Vergleich zu GPT-3, geeignet für kleinere Projekte.

Nachteile

Geringere Modellgröße schränkt die Vielfalt des Wissens ein, veraltete Trainingsdaten im Vergleich zu neueren Modellen.

Funktionen

Kreatives Schreiben, Textvervollständigung, Dialogsysteme, Textzusammenfassungen.

T5

Vorteile

Nachteile

Funktionen

Vorteile

Einheitliches Modell für verschiedene NLP-Aufgaben, unterstützt Multitasking-Lernen, effizient für Transfer-Lernen.

Nachteile

Geringerer Schwerpunkt auf Feinabstimmung, erfordert domänenspezifisches Training für bestimmte Aufgaben, größere Modellgröße.

Funktionen

Textklassifizierung, maschinelle Übersetzung, Dokumentenerstellung, Zusammenfassung.

3.3 ChatGPT und seine Auswirkungen auf die Content-Erstellung und die Gesellschaft

Generative KI hat die Welt im Sturm erobert. Sie hat einen Bereich erschlossen, der bis vor kurzem nur den Menschen vorbehalten war – den kreativen Bereich. Von atemberaubenden Bildern auf Knopfdruck über komplexe Blogartikel zu langen wissenschaftlichen Texten. KI begeistert uns mit scheinbar unendlichen Möglichkeiten uns und macht uns neugierig auf die sich immer weiter entwickelnde Technologie.

Doch bei aller Freude dürfen wir das große Ganze nicht aus den Augen verlieren. Jede bahnbrechende Technologie birgt auch große Risiken. Wie wird sich KI in unseren Alltag integrieren? Wie wird sie unser Verhalten verändern? Welche neuen Verhaltensweisen und Gewohnheiten werden entstehen? Sind wir in der Lage, mit diesen Veränderungen umzugehen? Wie wird sich die Technologie auf die Unternehmen auswirken und werden bestimmte Geschäftsbereiche vielleicht überflüssig?

Die Schwierigkeit besteht darin, dass wir die Auswirkungen erst erkennen, wenn sie bereits eingetreten sind. Und wir erkennen erst dann, wie gefährlich das alles sein könnte, wenn wir spüren, dass das bedroht ist, was wir am meisten schätzen – unsere Sicherheit.

Generative KI ist ein leistungsstarkes Instrument, das hochqualifizierte Arbeiter fördert und reguläre Arbeitskräfte benachteiligen kann, deren Arbeitsplätze gerade wegen dieser ungleichen Machtverteilung überflüssig werden könnten. Einem globalen Wirtschaftsforschungsbericht von Goldman Sachs zufolge sind etwa zwei Drittel der derzeitigen Arbeitsplätze zu einem gewissen Grad von der KI-Automatisierung betroffen. Darüber hinaus könnte generative KI bis zu einem Viertel der derzeitigen Arbeit ersetzen und rund 300 Millionen Arbeitsplätze automatisieren. Aber das sind nicht nur schlechte Nachrichten. Während der Einfluss der KI auf den Arbeitsmarkt erheblich sein dürfte, sind die meisten Arbeitsplätze und Branchen nur teilweise von der Automatisierung betroffen, was darauf hindeutet, dass die KI eher eine Ergänzung als ein Ersatz sein wird. Die Automatisierung von Prozessen und die Einführung von KI in bestimmten Arbeitsbereichen kann zu einer höheren Produktivität führen, so dass mehr Zeit für den Erwerb neuen Wissens zur Verfügung steht, was wiederum die Produktion steigern kann. Akademische Studien zeigen, dass Beschäftigte in Unternehmen, die KI frühzeitig einführen, einen erheblichen Anstieg der Arbeitsproduktivität beobachten, der in der Regel zu einer Steigerung von etwa 2-3 Prozentpunkten pro Jahr führt.

Generative KI kann die Produktivität erheblich steigern. Früher brauchte man Stunden, um einen ansprechenden Flyer oder eine Präsentation zu erstellen. Heute gibt es eine Vielzahl von KI-gestützten Tools, mit denen Sie auf Knopfdruck visuell ansprechende Materialien erstellen und diese dann nach Belieben verfeinern können. Warum Zeit mit Recherchen und dem Sammeln von Ressourcen verbringen, wenn Sie einfach generative KI verwenden können und Ihren ersten Entwurf in wenigen Minuten erstellen können?

Und genau hier besteht das Risiko. Ja, die KI kann viele manuelle und mühsame Aufgaben automatisieren, die Ihr Gehirn ohnehin nicht stimulieren würden. Und das ist völlig in Ordnung. Wenn man sich aber so sehr auf die Funktionalitäten der generativen KI verlässt, können die Menschen passiv werden. Sie fangen an, mittelmäßige Inhalte zu akzeptieren, solange sie ihnen helfen, ihre Arbeit schneller zu erledigen. Sie hören auf, kritisch zu denken und fangen an, sich der massenhaften Verbreitung von Informationen zu fügen, die voreingenommen und potenziell schädlich sein können. Denn wer hat schon die Zeit, jede Behauptung von ChatGPT zu überprüfen? In Anbetracht der Tatsache, dass die Daten, auf die es trainiert wurde, nur Informationen und Forschungsergebnisse bis zum Jahr 2021 enthalten und dass es keine wissenschaftlichen Quellen für seine Aussagen angibt, sollte ChatGPT mit Vorsicht und immer als Ergänzung, niemals als Hauptinstrument verwendet werden. Wenn wir uns ausschließlich auf KI verlassen, um Inhalte zu generieren, laufen wir Gefahr, zu passiven Zuschauern zu werden und unsere Kreativität, unsere Neugier und unseren Eifer, etwas zu schaffen und zu lernen, zu ersticken. Und ist es nicht genau das, was den Menschen ausmacht?

4. Abschließende Gedanken

Von der Erstellung fesselnder Geschichten und der Komposition großartiger Musik bis hin zu einer branchenübergreifenden Revolution bei der Erstellung von Inhalten – das Potenzial der generativen KI ist enorm. Wir sollten jedoch bedacht vorgehen, wenn wir diese Technologie nutzen wollen. Während die Möglichkeiten immens sind, müssen wir die ethischen Aspekte, Vorurteile und Risiken berücksichtigen, die mit einem zu starken Vertrauen in KI-generierte Inhalte verbunden sind. Wenn wir das richtige Gleichgewicht zwischen menschlicher und künstlicher Intelligenz finden, können wir eine Zukunft gestalten, in der generative KI zu einem mächtigen Werkzeug wird, das unsere Kreativität steigert und unsere Fähigkeiten erweitert. Eine Zukunft, in der sich menschlicher Einfallsreichtum und maschinelle Innovation kreuzen, um eine bessere Welt zu schaffen. Eine Zukunft, in der die Möglichkeiten endlos sind und eine harmonische Koexistenz besteht. Eine Zukunft, auf die wir gerne zusteuern würden.

Bei simpleshow arbeiten wir seit 7 Jahren mit der Kraft der KI, um unseren Nutzern die Möglichkeit zu geben, Videoinhalte auf Knopfdruck zu erstellen, und räumen dabei gleichzeitig der Datensicherheit oberste Priorität ein.

Wir sind der festen Überzeugung, dass generative KI ein unbegrenztes Potenzial bietet, um Kommunikation und Arbeit produktiver und effizienter zu gestalten. Mit diesen Fähigkeiten und ihrer ständigen Weiterentwicklung kann die generative KI für die Lösung zahlreicher Herausforderungen eingesetzt werden.

Mit dem KI-gestützten Story Generator von simpleshow ist das Erstellen professioneller Erklärvideos einfacher als je zuvor. Wir haben mit dem Story Generator eine leistungsstarke Technologie entwickelt, die auf textgenerativer KI basiert und diese um Storytelling- und Sicherheitfeatures erweitert.

Schaue dir die Aufzeichnung der Feature-Premiere an und erfahre, wie du mit dem Story Generator schnell und sicher professionelle Videoskripts erstellst.